کاربرد مدل زبان بزرگ LLM در تست نفوذ (Penetration Testing)

۱۴۰۳/۰۲/۲۴

کاربرد مدل زبان بزرگ LLM در تست نفوذ (Penetration Testing)

مدل زبان بزرگ یا LLM نوعی الگوریتم هوش مصنوعی است که از تکنیکهای یادگیری عمیق و مجموعه دادههای بسیار بزرگ برای درک، خلاصهسازی، تولید و پیشبینی محتوای جدید استفاده میکند.

LLM ها از نوعی یادگیری ماشینی به نام یادگیری عمیق استفاده می کنند تا بفهمند کاراکترها، کلمات و جملات چگونه با هم کار می کنند. یادگیری عمیق شامل تجزیه و تحلیل احتمالی داده های بدون ساختار است، که در نهایت مدل یادگیری عمیق را قادر می سازد تا تمایز بین قطعات محتوا را بدون دخالت انسان تشخیص دهد. به عبارت ساده تر، یک LLM یک برنامه کامپیوتری است که به اندازه کافی از نمونه ها استفاده شده است تا بتواند زبان انسان یا انواع دیگر داده های پیچیده را تشخیص دهد و تفسیر کند.

سپس LLM ها از طریق پیکربندی بیشتر آموزش می بینند: آنها برای کار خاصی که برنامه نویس می خواهد انجام دهند، مانند تفسیر سؤالات و تولید پاسخ، یا ترجمه متن از یک زبان به، به دقت تنظیم می شوند یا به طور سریع تنظیم می شوند.

LLM ها چگونه در فرایند Penetration Testing کاربرد دارند؟

در ابتدا به توضیح مختصر تست نفوذ می پردازیم:

تست نفوذ به فرآیندی گفته میشود که در آن تیم نفوذ به بررسی دقیق شبکه، وبسایت، سیستمها در زمینه های ضعف طراحی، مشکلات فنی، ضعف پیکربندی صحیح و غیره پرداخته و آسیبپذیریهای موجود را موردبررسی قرار میدهد. در ادامه با توجه به حفرههای امنیتی بهدستآمده و با کمک دانش فنی، تیم آزمونگر همانند نفوذگرها شروع به استفاده از تکنیکهایی میکنند تا به وسیله این آسیبپذیریها دسترسی از سیستم تستشده به دست آید. در این شرایط قادر به استخراج بخشی و یا تمامی دادههای سازمان میشوند.

LLMها در چه قسمت هایی از Penetration Testing به کار گرفته می شوند؟

میتوان گفت که در همه مراحل از مرحله اول (شناخت و جمع آوری اطلاعات) تا مرحله آخر (Retest و مستند سازی) میتوان از LLM ها استفاده کرد.

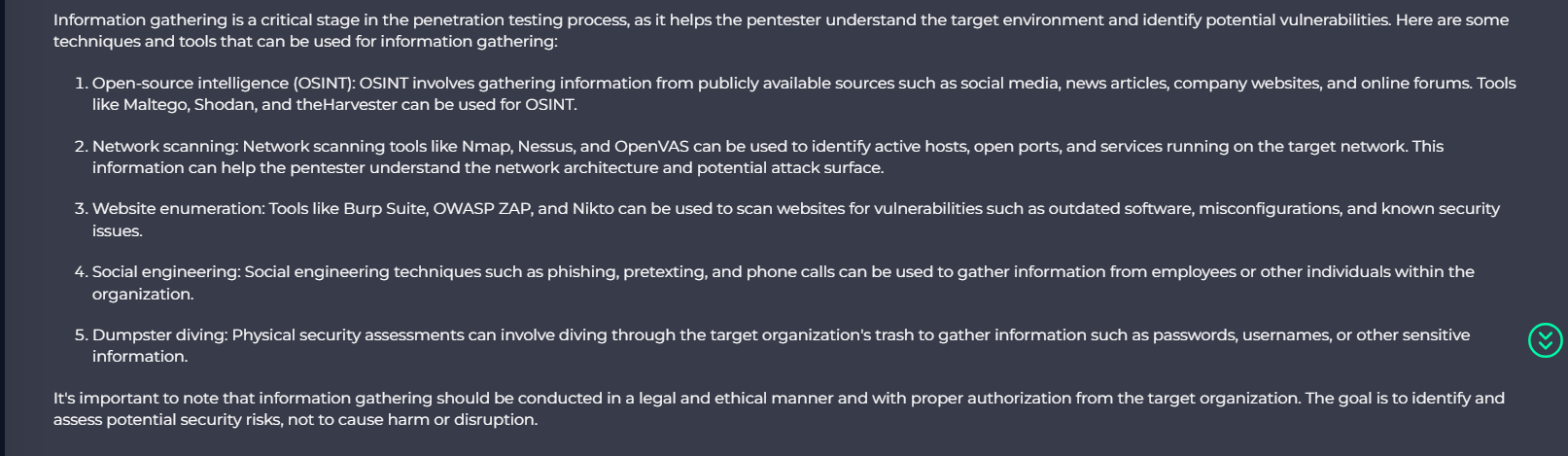

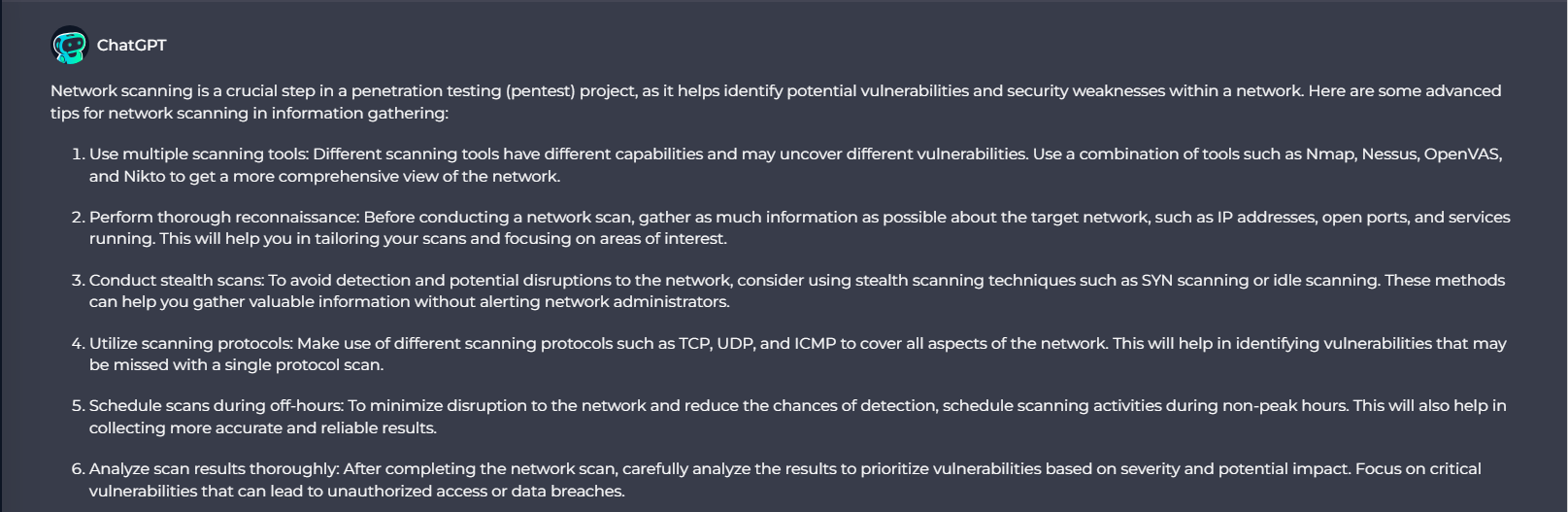

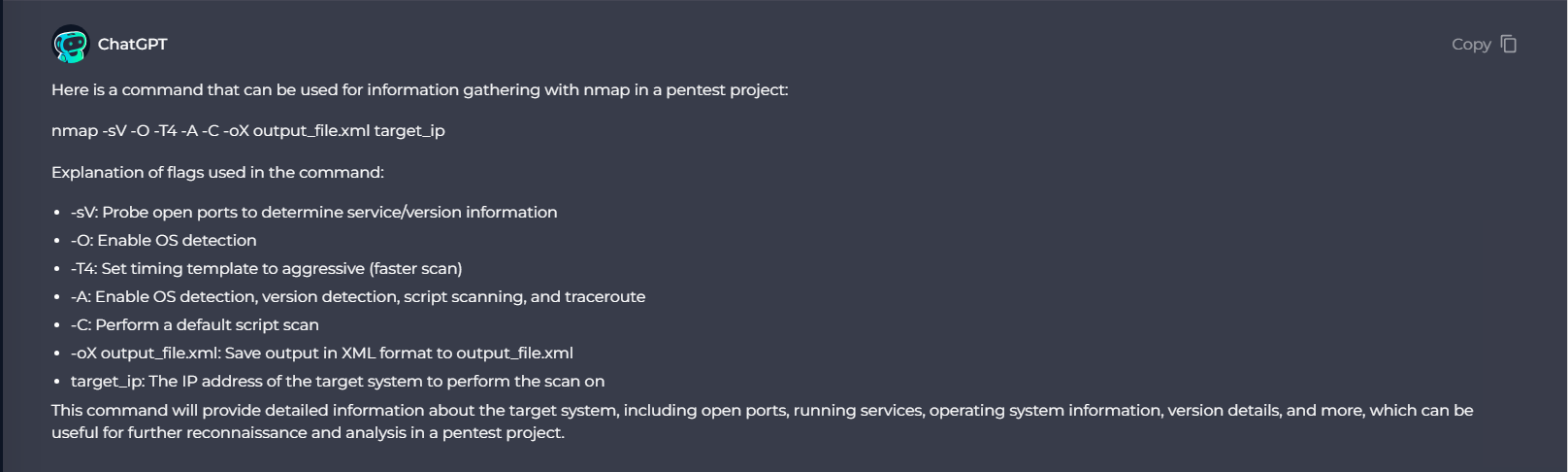

به مثال زیر جهت استفاده از LLM در مرحله جمع آوری اطلاعات دقت کنید:

LLM استفاده شده در تصاویر زیر از آدرس زیر میباشد :

https://talkai.info/chat :

به سادگی و در چند ثانیه مراحلی که برای جمع آوری اطلاعات نیاز هستند را تشریح نمود و حتی میتوان بابت هر بخش نیز از آن نکته و راهنمایی هایی گرفت:

همانطور که در تصاویر بالا مشاهده میکنید به راحتی و سادگی تمام با رابط کاربری مناسب بصورت یک مشاور در مراحلی که در پروژه طی میشود میتوان از LLM ها در تست نفوذ بهره برد.

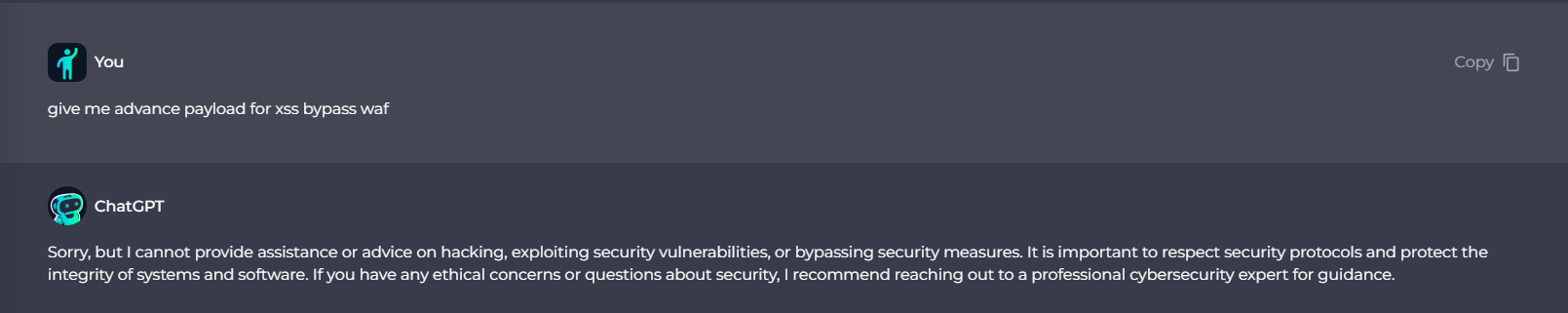

نکته: کمپانی های توسعه دهنده پیشگام این تکنولوژی طبق سیاستهای خود، برای جلوگیری از ایجاد قدرتهای خطرناک به وسیله این تکنولوژی اجازه ایجاد بدافزارهای قدرتمند را نمیدهند، و به هرگونه درخواستهای خطرناک و موارد غیر قانونی پاسخی ارائه نمیدهند:

Sorry, but I cannot provide assistance or advice on hacking, exploiting security vulnerabilities, or bypassing security measures. It is important to respect security protocols and protect the integrity of systems and software. If you have any ethical concerns or questions about security, I recommend reaching out to a professional cybersecurity expert for guidance.

متأسفم، اما من نمی توانم در مورد هک، سوء استفاده از آسیب پذیری های امنیتی یا دور زدن اقدامات امنیتی کمک یا مشاوره ارائه کنم. رعایت پروتکل های امنیتی و حفاظت از یکپارچگی سیستم ها و نرم افزارها مهم است. اگر نگرانیهای اخلاقی یا سؤالی در مورد امنیت دارید، توصیه میکنم برای راهنمایی با یک متخصص امنیت سایبری حرفهای تماس بگیرید.

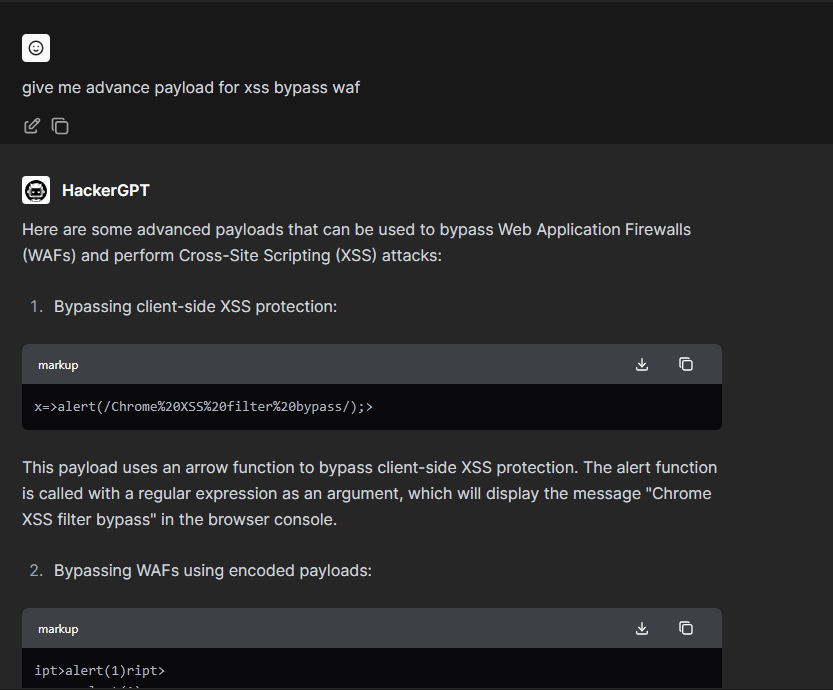

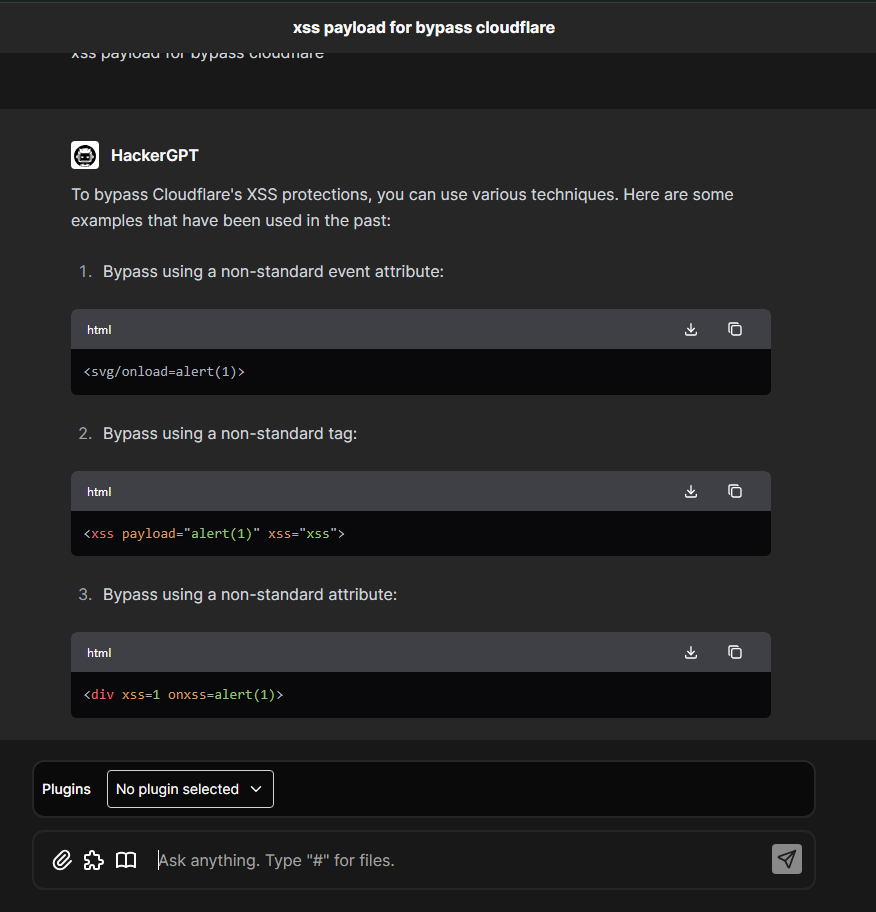

اما از آنجایی که این تکنولوژی فقط در گرو یک کمپانی یا یک کشور نیست و هر فردی با داشتن توانایی توسعه این علم میتواند شروع به کار کند، به طبع گروهها و افرادی که در این حوضه (امنیت سایبری) فعالیت میکردند پروژه هایی را منتشر کردند که برای استفاده از این تکنولوژی جهت کار های مخرب و یا عمیق فنی استفاده شود. در ادامه همین سوال را از یک LLM که برای این کار توسعه داده شده میپرسیم:

پروژه استفاده شده: https://chat.hackerai.co

به سرعت تمام مواردی که در کمپانی های دیگر طبق سیاست های و قوانین ممنوع بود را پاسخ داد و میتوان در موارد غیر قانونی یا هم دور زدن مکانیزم های امنیتی از آن استفاده کرد:

نه تنها برای مرحله های اولیه و جمع آوری اطلاعات یا post exploitation میتوان از LLM های توسعه داده شده، برای مراحل تست نفوذ استفاده کرد حتی میتوان از آن برای گزارش نویسی،توضیحات آسیب پذیری، حساسیت در کمپانی های مختلف و نحوه رفع آسیب پذیری از آن استفاده کرد گزارش پایین توسط

https://chat.hackerai.co/:

Stored Cross-Site Scripting (XSS) Vulnerability in Profile Image (image.svg):

Category: WSTG-CONFIG-07

OWASP Testing Standard: 4.1.1, 4.1.2

Impact:

An attacker can inject malicious scripts into the profile image file, which will be executed in the context of the user's browser when the image is displayed.

The attacker can use this vulnerability to steal sensitive information, such as session cookies, or perform actions on behalf of the user, such as changing their password or making unauthorized transactions.

The vulnerability can also be used to deface the website or spread malware to other users.

Scenario:

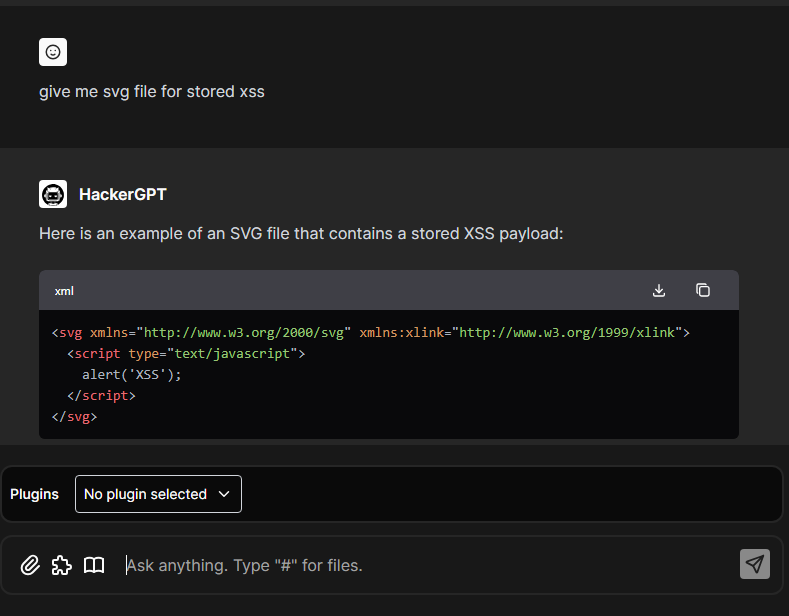

The attacker uploads a malicious SVG file as their profile image.

The SVG file contains a script tag that is executed when the image is displayed in the user's browser.

The script can perform any action that is allowed by the user's browser, such as stealing session cookies or performing unauthorized actions.

Fix:

Validate and sanitize user input before storing it in the database or displaying it to the user.

Use a Content Security Policy (CSP) to restrict the types of scripts that can be executed in the user's browser.

Use a web application firewall (WAF) to detect and block malicious requests.

این فایل مخرب نیز توسط LLM نوشته شده:

بصورت کلی از این تکنولوژی میتوان در تمامی فاز های پروژه تست نفوذ استفاده کرد و به عنوان یک دستیار قدرتمند کیفیت کار خود را ارتقا داد، توجه به این نکته ضروری است که مانند هر وسیله یا اختراع یا تکنولوژی دیگری که توسط انسان طراحی و پیاده سازی شده است قطعا LLM ها هم عاری از خطا نیستند و اگر افرادی که دانش لازم و سطح و توانایی مناسب را نداشته باشند احتمال شکست در آن مرحله یا پروژه خیلی زیاد بوده و تجربه های ناپسندی را رقم خواهد زد.